tf.nn.conv2d与tf.layers.conv2d的区别是什么

tf.nn.conv2d与tf.layers.conv2d的区别

在写CNN中注意到tensorflow目前有tf.nn.conv2d和tf.layers.conv2d这两个很相似的API.

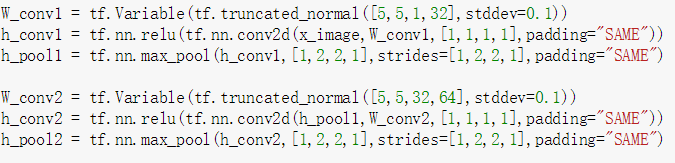

tf.nn.conv2d, 需要自行传入初始化好的filter(四个维度),在初始化filter或者说Weights中,已经手动选择了初始化方案,一般用的是tf.truncated_normal。另外tf.nn.conv2d中激活函数需要另外写。

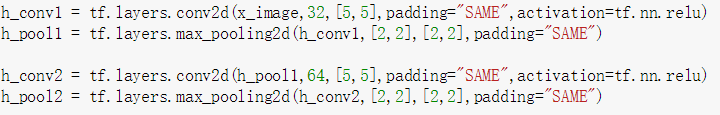

而在tf.layers.conv2d中,只要写入n和size,参数列表中kernel_initializer默认是None, 不清楚这里的参数是如何初始化的? tf.layers.conv2d中,激活函数是一个参数,不需要另外调用。

一般推荐使用tf.layers.下面的函数,用起来方便。但是在tf2.0里,tf.layers.下面的API也都被遗弃了,tf2.0推荐使用keras.layers下面的API。

tf.nn.conv2d

tf.layers.conv2d

tf.nn.conv2d和tf.layers.conv2d的学习

看了很多tensorflow卷积的例子,有的用了tf.nn.conv2d,有的用了tf.layers.conv2d,那么这两个究竟有啥不同呢?

tf.layers.conv2d(inputs, filters, kernel_size, strides=(1,1), padding='valid', data_format='channels_last', dilation_rate=(1,1), activation=None, use_bias=True, kernel_initializer=None, bias_initializer=init_ops.zeros_initializer(), kernel_regularizer=None, bias_regularizer=None, activity_regularizer=None, trainable=True, name=None, reuse=None) tf.nn.conv2d(input, filter, strides, padding, use_cudnn_on_gpu=None, data_format=None, name=None)

对于卷积来说,作用是一样的。tf.layers.conv2d 使用tf.nn.convolution作为后端。

一个参数要注意一下:

filter:是一个4维张量,其type必须和输入一样,

[filter_height, filter_width, in_channels, out_channels]

filters:一个整数,输出空间的维度,也就是卷积核的数量。

tf.layers.conv2d参数丰富,一般用于从头训练一个模型。

tf.nn.conv2d,一般在下载预训练好的模型时使用。